Разработка систем работы с Big Data в Екатеринбурге

Мы разрабатываем комплексные системы сбора данных разработка, проектирование систем обработки данных и создание платформ визуализации данных для компаний, которым важно управлять информацией и принимать решения на основе аналитики. Наша задача — построить инфраструктуру данных, обеспечить сбор, хранение, обработку и визуализацию больших объемов информации с учетом бизнес задач и требований безопасности. Компания АвикейКтр работает с 2011 года. При заказе услуги под ключ скидка от 15 процентов. Опыт работы каждого нашего программиста не менее 10 лет.

Услуга включает анализ текущей архитектуры, выбор стека для разработки систем анализа больших данных, настройку процессов ETL и разработку ПО для сбора и аналитики данных. Мы проектируем аналитические платформы, создаем сервисы аналитики данных и инструменты визуализировать результаты. Важные компоненты: хранение в распределенных базах, обработка потоков, batch аналитика, построение отчетов и управление метаданными.

- проектирование систем обработки данных с учетом нагрузок и SLA

- разработка инфраструктуры данных и автоматизация процессов сбора

- создание сервисов аналитики данных и платформы визуализации

- интеграция с источниками: базы, API, логи, сенсоры

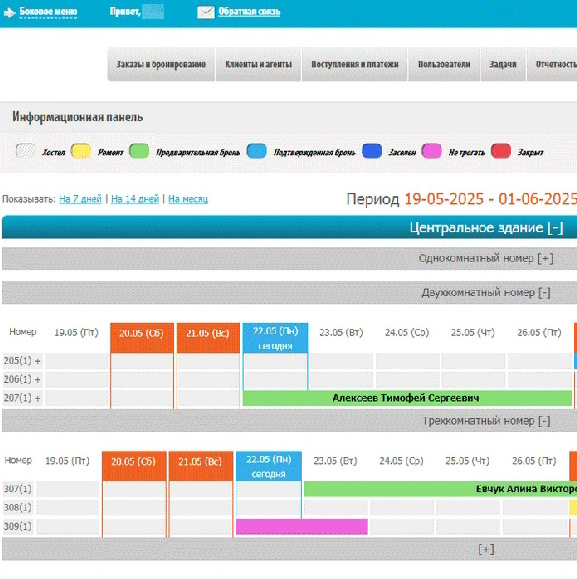

Мы ценим прозрачность процессов и готовим документацию по всем этапам: проектирование архитектуры, разработка модулей, тестирование и сопровождение. Стоимость разработки систем анализа данных и стоимость создания платформы формируется после технико-экономического анализа и зависит от объема данных, требований к отказоустойчивости и скорости обработки. Для малого и среднего бизнеса предлагаем модульные решения, которые можно масштабировать при росте нагрузки. В наших проектах используются современные технологии для обработки больших данных, распределенные очереди, in-memory кэширование и инструменты для визуализации отчетов и дашбордов.